Spark是分布式计算平台,主要承担实验引擎发送过来的计算任务,包含Master和Worker两部分,其中Worker实例可以横向扩展。

1、系统环境准备

注意:如果服务部署集群,集群内所有服务器均需设置系统环境。 |

1.1防火墙配置

为了便于安装,建议在安装前关闭防火墙。使用过程中,为了系统安全可以选择启用防火墙,但必须启用服务相关端口。

1.关闭防火墙

临时关闭防火墙

systemctl stop firewalld |

永久关闭防火墙

systemctl disable firewalld |

查看防火墙状态

systemctl status firewalld |

2.开启防火墙

相关服务及端口对照表:

| 服务名 | 需要开放端口 |

|---|---|

| Spark | 8080,8081,7077,[30000-65535] |

如果确实需要打开防火墙安装,需要给防火墙放开以下需要使用到的端口

开启端口:8080,8081,7077,[30000-65535]

firewall-cmd --zone=public --add-port=8080tcp --permanent firewall-cmd --zone=public --add-port=8081/tcp --permanent firewall-cmd --zone=public --add-port=7077/tcp --permanent firewall-cmd --zone=public --add-port=30000-65535/tcp --permanent |

配置完以后重新加载firewalld,使配置生效

firewall-cmd --reload |

查看防火墙的配置信息

firewall-cmd --list-all |

3.关闭selinux

临时关闭selinux,立即生效,不需要重启服务器。

setenforce 0 |

永久关闭selinux,修改完配置后需要重启服务器才能生效

sed -i 's/=enforcing/=disabled/g' /etc/selinux/config |

1.2 安装Java环境

安装包解压到/opt目录

tar -zxvf jdk8.0.202-linux_x64.tar.gz -C /opt |

配置java环境变量

①在/etc/profile 文件末尾添加,并保存

export JAVA_HOME=/opt/jdk8.0.202-linux_x64 export JRE_HOME=$JAVA_HOME/jre export CLASSPATH=.:$JAVA_HOME/lib:$JRE_HOME/jre/lib:$CLASSPATH export PATH=$JAVA_HOME/bin:$JRE_HOME/bin:$PATH |

②使配置生效

source /etc/profile |

③查看java版本信息

java -version |

2、Spark单机部署

1.修改主机名-添加映射关系

hostnamectl set-hostname 主机名 |

PS:主机名不能使用下划线

配置主机名和IP的映射关系

vi /etc/hosts |

内容设置,例如:

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 10.10.17.186 smartbi-spark |

2.设置系统免密登陆

生成密钥

ssh-keygen |

输入ssh-keygen后,连续按三次回车,不用输入其它信息

复制公钥

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys chmod 0600 ~/.ssh/authorized_keys |

测试是否设置成功,例如:

ssh root@smartbi-spark |

如果不用输入密码,表示成功。

3.安装Spark

解压spark安装包到指定目录

tar -zxvf spark-2.4.0-bin-hadoop2.7.tgz -C /opt |

4.启动Spark

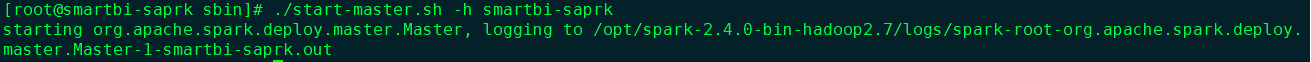

①启动Spark master

cd /opt/spark-2.4.0-bin-hadoop2.7/sbin ./start-master.sh -h 主机名 |

例如:主机名为smartbi-spark,则执行:

./start-master.sh -h smartbi-spark |